🤔 Neural Network

인공신경망(人工神經網, 영어: artificial neural network, ANN)은 기계학습과 인지과학에서 생물학의 신경망(동물의 중추신경계중 특히 뇌)에서 영감을 얻은 통계학적 학습 알고리즘입니다.

인공신경망은 시냅스의 결합으로 네트워크를 형성한 인공 뉴런(노드)이 학습을 통해 시냅스의 결합 세기를 변화시켜, 문제 해결 능력을 가지는 모델 전반을 가리킵니다.

이번 포스팅에서는 역전파에 대해 알아보겠습니다.

🔎 역전파(Backpropagation)

1957년에 perceptron이 나오고 1969년에 MLP가 나왔음에도 불구하고 1986년까지 가중치를 구하는 방법을 구하지 못했습니다.

이것을 해결하게 된 알고리즘이 역전파 알고리즘입니다.

역전파 알고리즘은 오류역전파 알고리즘이라고도 합니다.

이때부터 Neural Network가 다시 살아나게 되었습니다.

아래의 그림을 살펴보겠습니다.

output을 구할 때 Loss 계산이 필요한데 이때 역방향으로 이동하며 어떤 값이 높은 Loss값의 원인이 되었는지를 추적합니다,

비유를 하자면 진상규명을 통해 책임자 처벌을 하는 것입니다.

역전파 알고리즘을 이해하기 위해 Gradient Descent에 대해 알아야 합니다.

🔎 경사하강법(Gradient Descent)

경사 하강법에 대한 내용은 Gradient Boost를 배우며 설명했습니다.

아래의 링크를 참고하시길 바랍니다.

https://2t-hong.tistory.com/122

[ML] Ensemble Method(4) - Gradient Boost

🤔 Ensemble Method 통계학과 기계 학습에서 앙상블 학습법은 학습 알고리즘들을 따로 쓰는 경우에 비해 더 좋은 예측 성능을 얻기 위해 다수의 학습 알고리즘을 사용하는 방법 입니다. 통계 역학에

2t-hong.tistory.com

그래도 경사하강법을 조금 설명하자면 기울기의 반대방향으로 이동하며 기울기를 감소시키는 방법입니다.

이러한 방법을 통해 기울기의 최저점을 찾을 수 있습니다.

✍ 최적화 방법

- 단계적으로 가중치를 업데이트

$w_0$의 경우 랜덤하게 정합니다.

이를 일부 개선한 것이 $w_1$ → $w_2$ ... 입니다.

개선하는 방법은 위의 링크에 자세히 설명되어 있습니다.

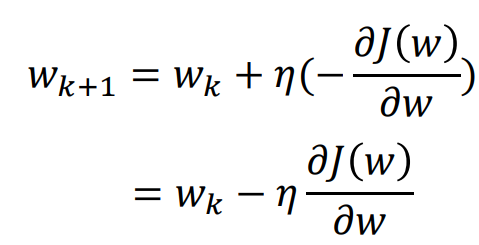

수식으로 나타낸다면 아래와 같습니다.

- 어떤 방향으로 이동?

이때 값을 이동할 방향을 정해야 하는데 우리가 구해야 하는 것은 목적함수를 최소화 하는 것이므로 해당 방향으로 이동해야 합니다. (해당 식에서의 목적함수는 Loss Function 입니다.)

그러므로 $w_k$에서의 기울기의 역방향으로 이동하면 됩니다.

이를 그림과 식으로 나타내면 아래와 같습니다.

- 얼만큼 이동?

정확하게 얼만큼 이동해야 할 지는 모르지만 기울키가 크다면 많이 이동하고 작다면 조금만 이동하면 됩니다.

이를 아래와 같이 나타내겠습니다.

즉, 이동하는 만큼의 양을 해당 식으로 나타낼 수 있습니다.

🔎 역전파의 이해

우리가 구해야할 목적함수이자 MLP의 Loss Function을 수식으로 나타내면 아래와 같이 나타낼 수 있습니다.

손실의 계산 , Error 또는 정확도 계산을 미분 가능한 형태로 만든다면 후속 조치를 하기 쉽습니다.

MSE를 사용한 이유

추가적으로 위의 수식을 뜯어보면 MSE라고 할 수 있습니다.

MSE는 performance에 대한 측정 방법입니다.

MSE는 최적화를 위한 측정 방법이기 때문에 이를 바로 활용할 수 있습니다.

그래서 대부분의 Loss Function은 MSE를 이용합니다.

✍ 해당 식의 term들의 의미

$k$ : output node의 number라고 생각하면 됩니다.(개수가 아님에 주의)

$t_k$ : target, $y$

$z_k$ : model output, $\hat{y}$

이를 실제로 계산하여 흐름을 이해해보도록 하겠습니다.

흐름의 이해를 통해 실제로 가중치가 어떤 방식으로 업데이트가 되는지를 집중해서 보시길 바랍니다.

아래의 그림은 앞의 순전파에서 사용했던 MLP노드입니다.

식의 계산을 쉽게 하기 위해 수식을 미리 정리해 두었습니다.

Input은 $i$, Hidden은 $j$, Output은 $k$를 컨트롤합니다.

Loss는 $Z_1, Z_2$를 통합하여 계산됩니다.

우리는 Loss를 목적함수로 사용하며 이를 가중치로 미분해야합니다

위의 그림에서 가중치는 두 단계 존재하는데 Input to Hidden, Hidden to Output의 가중치입니다.

Loss도 마찬가지로 두 단계 전부 미분을 해야합니다.

우리는 Chain Rule로 미분을 진행할 것이기 때문에 Loss Function에 가까운 식이 훨씬 간단하므로 Hidden to Output을 먼저 살펴보겠습니다.

✍ Loss Function 미분, 가중치 Update ( Hidden to Output )

해당 식을 바탕으로 Loss Function을 미분해보겠습니다.

결론적으로 Loss Function을 미분하면 아래와 같은 식을 얻을 수 있습니다.

해당 식을 이해하는것이 더욱 중요합니다.

가중치의 업데이트를 이해하면 아래와 같이 이해할 수 있습니다.

즉, $\delta_k$ 는 output node의 sensitivity를 의미하며 $y_j$는 기여도를 의미합니다.

Error backpropagation이라는 것은 결국 반대방향으로 계속 전파해 나갈 것인데 전파의 정도가 $\delta_k$와 $y_j$ 따라 변화한다고 보시면 됩니다.

비유하자면 목소리를 크게 주장한 사람 때문에 더 큰 책임을 지게 된다는 것입니다.

✍ Loss Function 미분, 가중치 Update ( Input to Hidden )

위에서 살펴본 것은 Hidden to Output이었기 때문에 Loss Function 하나만을 고려해주면 됐습니다.

하지만 Input to Hidden의 경우에는 아래의 그림에서 빨간색으로 색칠한 모든 노드를 고려해야 합니다.

즉, $w_{ji}$를 업데이트 하기 위해 타고가야 하는 path는 아래의 빨간 화살표 두 개를 모두 고려해야만 합니다.

중첩되어있는 가중치 Update가 어려웠기 때문에 MLP에서 공백기가 왔던 것입니다.

Hidden to Output과 같은 방식으로 미분을 진행합니다.

식을 Chain Rule을 통해 계산하면 아래와 같이 나타낼 수 있습니다.

정리하면 아래의 수식을 얻을 수 있습니다.

해당 식에서도 마찬가지로 각 term이 어떤 것을 의미하는지를 알아봐야 합니다.

결국 $ w_{ji}$를 update하기 위해 $x_1$로 들어오는 입력 시그널이 얼마나 큰 지를( 목소리가 얼마나 큰 지) 해당 부분에서 직접 계산하라는 것입니다.

이후 얼마나 민감하게 받아들이고 있는가는 $\delta_j$를 통해 알 수 있습니다.

또한 $\delta_j$는 output 노드들의 sensitivity에 영향을 받습니다

최종적으로 많이 틀리면 틀릴 수록 Loss가 상승하므로 더 많은 Error가 있을 때 더 많은 weight update가 일어납니다.

.

여기서 아래의 빨간 부분은 눈여겨 봐두시기를 바랍니다. ( Deep Learning에서 사용 )

다음 포스팅에서는 역전파 알고리즘에 대해 조금 더 알아보도록 하겠습니다.

'AI > Machine Learning' 카테고리의 다른 글

| [ML] 핸즈온 머신러닝 - 10장(다양한 모델 만들기) (0) | 2023.01.03 |

|---|---|

| [ML] Neural Network(6) - 역전파(Backpropagation)(2) (0) | 2022.12.06 |

| [ML] Neural Network(4) - 순전파(Feedforward Process) (0) | 2022.12.01 |

| [ML] Neural Network(3) - MLP(Multilayer Perceptron) (0) | 2022.12.01 |

| [ML] Neural Network(2) - Linear Separability (0) | 2022.12.01 |

![[ML] Neural Network(5) - 역전파(Backpropagation)(1)](https://img1.daumcdn.net/thumb/R750x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FnWeIk%2FbtrSYm9J5JG%2FJ6ktXXkRZIZEGXfg5l0q51%2Fimg.jpg)